Puntos clave de la noticia:

-

Las pruebas de conocimiento cero permiten auditar modelos de IA sin revelar datos sensibles ni la lógica interna de los algoritmos.

-

El Zero-Knowledge Machine Learning ofrece una vía para verificar que los sistemas no discriminan sin sacrificar privacidad ni propiedad intelectual.

-

Los avances recientes mejoraron la escalabilidad de estas pruebas, acercándolas a una adopción viable en entornos de machine learning de alta demanda.

En los últimos años, el debate en torno a la imparcialidad de la inteligencia artificial (IA) ha ganado peso, y con razón. A medida que los sistemas algorítmicos penetran en aspectos esenciales de la vida cotidiana —como el acceso a créditos, oportunidades laborales o incluso los resultados de buscadores y generadores de imágenes—, la posibilidad de que operen con sesgos no es menor. El desafío está en cómo auditar y garantizar que estos modelos sean realmente justos, evitando sacrificar la privacidad de los usuarios ni la propiedad intelectual de las empresas que los desarrollan.

El Potencial de las Pruebas de Conocimiento Cero

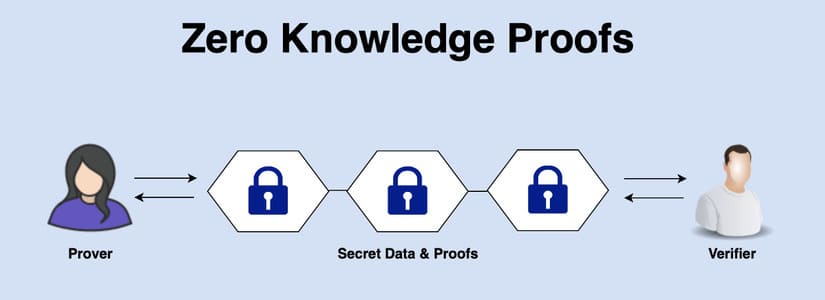

Las pruebas de conocimiento cero (zero-knowledge proofs o ZKPs) se perfilan como una solución prometedora. Si bien este concepto surgió en el ecosistema cripto como una herramienta para validar transacciones sin revelar información sensible, su potencial va mucho más allá de la blockchain. Hoy, las ZKPs pueden aplicarse para corroborar, de forma efectiva y privada, que los modelos de machine learning (ML) no discriminan a personas por motivos como raza, género o condición socioeconómica.

Cómo Funciona el Zero-Knowledge Machine Learning

El problema de los sesgos en la IA no es nuevo. Ha habido casos de motores de crédito que califican personas en función de su entorno social o sistemas de generación de imágenes que reproducen estereotipos. Esto demuestra que los algoritmos pueden amplificar desigualdades. Detectar estas fallas es sencillo una vez que el daño está hecho. Lo difícil es garantizar que no ocurran desde el inicio y, más aún, probarlo ante terceros sin comprometer datos sensibles.

Ahí es donde entra en juego la combinación de las pruebas de conocimiento cero con IA. Esta novedosa solución, conocida como Zero-Knowledge Machine Learning (ZKML), permite verificar que un modelo se comporta de acuerdo con ciertos criterios —como no discriminar por atributos protegidos— sin necesidad de exponer ni los datos de entrenamiento ni la lógica interna del algoritmo. En la práctica, significa que una entidad podría demostrar que su sistema de aprobación de préstamos no privilegia ni perjudica a ningún grupo demográfico, todo sin revelar cómo funciona su modelo ni qué información maneja.

El Desafío de la Escalabilidad

Durante mucho tiempo, el principal obstáculo de esta tecnología fue su limitada escalabilidad. Las primeras implementaciones solo podían auditar una etapa puntual del proceso de machine learning, lo que dejaba lugar para manipulaciones previas o posteriores. Además, los tiempos de procesamiento eran tan altos que resultaban inviables para aplicaciones en tiempo real. Sin embargo, los avances recientes en frameworks de ZKPs han permitido ampliar su alcance a modelos de millones de parámetros, logrando resultados verificables y seguros.

¿Qué Significa «Justicia Algorítmica”?

Un punto clave en este debate es qué entendemos por “justicia algorítmica”. Existen distintas definiciones. Por ejemplo, la paridad demográfica busca que todos los grupos tengan igual probabilidad de obtener determinado resultado. Por su parte, la igualdad de oportunidades propone que quienes estén igualmente calificados reciban las mismas posibilidades de éxito, independientemente de su origen. Y la igualdad predictiva apunta a que la precisión de las predicciones sea similar para todos los grupos. Estas métricas no siempre coinciden entre sí, pero permiten establecer parámetros objetivos para evaluar modelos.

Regulación y Prioridades Políticas

Más allá de las consideraciones técnicas, este debate se desarrolla en un marco regulatorio cada vez más exigente. Estados Unidos y otras potencias han emitido lineamientos para controlar los sesgos en el uso de la IA, aunque las prioridades varían según los ciclos políticos. Mientras algunas administraciones fomentan políticas orientadas a la equidad de resultados, otras priorizan la igualdad de oportunidades. Esto produce una tensión constante sobre cómo definir y garantizar la justicia en sistemas automatizados.

Una Herramienta para la IA del Futuro

Una de las ventajas más interesantes de las pruebas de conocimiento cero es que pueden adaptarse a cualquier definición normativa sin comprometer la privacidad ni la competitividad de las compañías. Permiten auditar modelos de forma continua y autónoma, reduciendo la dependencia de revisiones manuales o intervenciones estatales que muchas veces llegan tarde.

Que la inteligencia artificial interviene en decisiones que afectan vidas reales ya es un hecho fáctico, contar con mecanismos transparentes y seguros para verificar su comportamiento se ha vuelto indispensable. Las pruebas de conocimiento cero, nacidas en el corazón de la tecnología blockchain, podrían convertirse en el estándar para una inteligencia artificial justa, confiable y respetuosa de la privacidad.